Luca Schäfer

Das deutsche Forschungsschiff "Polarstern" in der Arktis

(Bild: I. Noyan Yilmaz/Shutterstock.com)

Die USA haben die Arktis zurück auf die geopolitische Landkarte gebracht. Warum Berlin keine passende Antwort findet. Eine Analyse.

US-Präsident Donald Trump wollte Grönland "einschließlich Recht, Besitztitel und Eigentum" in Beschlag nehmen [1]. Nur Tage später kam ein Nato-US-Deal. Dennoch bleibt die Zukunft des europäischen Überseegebietes auf "dünnem Eis" [2].

Berlin misslang [3]eine starke Antwort. Bundeskanzler Friedrich Merz bewahrte [4] ausgerechnet gegenüber dem im Augenblick unbeteiligten Moskau vermeintlich Haltung: Man werde den "Norden vor der Bedrohung durch Russland schützen".

Dabei gerieten die bundesdeutschen strategischen Arktis-Leitlinien in Vergessenheit. Sind Sie Schnee von gestern?

Der zentrale Bezugspunkt der 46-seitigen [5] deutschen Arktispolitik bildet nicht Washington, sondern Moskau.

Wenn auch das Titelbild keine Fregatte, sondern ein Forschungsschiff zierte, brachte die damalige Ampelregierung zum Ausdruck, dass die Arktis nicht mehr als regionale Ausnahmezone ("arktischer Exzeptionalismus [6]") betrachtet werden könne, sondern zunehmend von sicherheitspolitischen Spannungen geprägt ist.Die deutsche Arktispolitik wurde gemäß der zwei Jahre zuvor ausgerufenen Zeitenwende [7] an ihre neuen Bestimmungslinien angepasst.

Dennoch wollte das politische Berlin, dies geht aus den begleitenden parlamentarischen Meldungen der Leitlinien hervor, an "kooperativen" Lösungen für sich überschneidende Ansprüche festhalten [8], denn in der Region kollidieren diverse internationale Ansprüche diametral. Auch die Gefahr einer atomaren Eskalationsgefahr [9], die aus den Wirren des Kalten Krieges bekannt ist, wird einberechnet.

Dennoch sind zivile Muster erkennbar: Die drastische Beschleunigung des Klimawandels, durch die sich die Arktis etwa viermal schneller erwärmt als andere Regionen, stellt einen wesentlichen Auslöser dar, der sowohl ökologische als auch ökonomische Dynamiken antreibt.

Abseitig eines ökonomischen Rohstoff-Great-Game [10] wird die zentrale Menschheitsgefahr des Klimawandel als handelspolitische Chance und Umweltrisiko benannt.

Der Thinktank Stiftung Wissenschaft und Politik (SWP) analysierte [11], dass die neuen Leitlinien den geopolitischen Raum der Arktis höher gewichten und zudem ganzheitlich – politisch, militärisch, ökonomisch – aktiv in den Fokus nehmen.

Parallelen zur deutschen Nationalen Sicherheitsstrategie von 2023 [12] sowie zu anderen regionalstrategischen Dokumenten (Indo-Pazifik 2020, China-Strategie 2023) sind augenfällig. International dürfte zumindest zum damaligen Zeitpunkt die nationale Arktisstrategie der USA ein Anknüpfungspunkt gewesen sein.

Washington akzentuierte deutlich vor Berlin einen veränderten strategischen Ansatz. Zur Zeit der ausgehenden Administration von Joe Biden versuchte [13]man sich an einer Balance zwischen Zusammenarbeit und Sicherheitsinteressen, welche unter Donald Trump, jedoch auch bereits ab 2022, deutlich zugunsten Letztgenannten zurechtgestutzt wurde.

Insgesamt lassen sich sechs zentrale Kategorien identifizieren. Die damalige Bundesregierung wollte dabei helfen, Sicherheit und Stabilität (1) in der Region zu wahren. Entscheidend ist hierbei – als Kontinuität deutscher Außen- und Sicherheitspolitik seit dem Zweiten Weltkrieg – dass dies nicht als deutscher Sonderweg verstanden wird, sondern eng im Rahmen von Nato und EU geschehen sollte.

Im Zuge der als immer unzuverlässiger wahrgenommenen US-Präsenz verlagerte [14] die Bundesregierung – in enger Absprache mit Brüssel – ihren Fokus auf den ohnehin ab 2008 in der EU-Administration gestarteten Konfigurationsprozess arktischer Strategiebildung, ohne dass sich dies jedoch zuvor in den Leitlinien hätte niederschlagen können.

Die bundesdeutsche Arktispolitik dürfte sich zukünftig noch stärker als bisher in den Rahmen Brüsseler Strategien einfassen lassen. Bemerkenswert war – innerhalb der Januar-Scharaden, dass eine von den USA entkernte "Nato-light"-Truppe, bestehend aus deutschen, skandinavischen und französischen Einheiten, als Erkundungsmission in die Region entsandt wurde [15].

Diese im Kern aus EU-Soldaten zusammengewürfelte Erkundungs-Kavallierie firmierte jedoch unter dem Nato-Label. Dabei war augenfällig, dass der Nato-Rahmen – ohne den starken US-Partner, mehr Schein, als Sein war.

Die Nibelungentreue zu den USA hat Gründe: Brüssel und Berlin sind auf Washington angewiesen.

Vor dem Hintergrund der Miniatur-Mission sprach [16] der italienische Verteidigungsminister Guido Crosetto von einem "Witz". Die rhetorische Ohrfeige eines Nato-Gründungsmitgliedes offenbart die gesamte Tragik deutsch-europäischer Arktisprojektionen: Während Berlin vollmundig eine rechtsnormierte Ordnung wie eine Monstrans vor sich herträgt, versagt insbesondere gegenüber dem vermeintlich befreundeten großen Bruder aus Washington die eigene Courage.

Was sind demnach die seitenlangen Ausführungen innerhalb der Leitlinien – arktisch-nordatlantische Allianz, Multilateralismus oder Selbstbestimmungsrecht der Ureinwohner – noch wert?

Insofern darf man dem kanadischen Premierminister Mark Carney durchaus einen Punkt geben [17]: Die regelbasierte Ordnung ist – für die Bewohner Grönlands – wohl das Papier nicht wert, auf dem sie verfasst wurde.

Jene Nebelbombe besaß schon vor Trump Kratzer, nun – mit einem EU-Mitglied und Nato-Partner als Bedrohungskulisse – im Kreuzfeuer stand die Ex-Kolonialmacht Dänemark, wird die unleugbare Realität, die spätestens mit Gaza in der südlichen Hemisphäre ins kollektive Bewusstsein einsickerte [18], auch im Westen vernommen.

Dutzende Seiten der Leitlinien sind dennoch den Bereichen Forschung und Wissenschaft (3), Klima- und Umweltschutz (4), Partizipation indigener Völker (5) sowie nachhaltiger Entwicklung (6) gewidmet.

Jene vier Ziele rangieren insofern gleichwertig neben Sicherheit und Recht. Keines der sechs dargestellten Primärziele der deutschen Arktisstrategie ist mit dem Gebaren der USA vereinbar, kaum eines mit der deutschen Politikgestaltung aus dem Januar in Einklang zu bringen.

Berlin besitzt mit den Leitlinien Argumente, schärfstens gegen die Politik Trumps zu protestieren, vergaß diese willentlich, als es darauf ankam. Die Bundesregierung trug mit der zahnlosen Entsendung eines kleinen Kontingents selbst zur fortschreitenden Militarisierung der Region bei.

Es erscheint, als seien die hehren Worte letztlich Beiwerk einer sich im weltpolitischen Block-Koordinatensystem verspekulierten politischen Klasse.

Die deutsche Politik steht vor einer Quadratur des Kreises: Gelingt es nicht, die imperialen Ansprüche Washingtons friedlich einzuhegen – wie zuletzt im Grönland-Deal zwischen Rutte und Trump –, kann das zentrale Ziel einer transatlantisch-arktischen Sicherheitsgemeinschaft, kaum mehr aufrechterhalten werden.

Es ist durchaus ironisch, dass der Totengräber der bisherigen arktischer Stragegie-Prämissen nicht im Kreml, sondern im Weißen Haus sitzen dürfte. Unter dem Primat der Sicherheit und angesichts der zu erwartenden Zunahme geopolitischer Rivalitäten – insbesondere mit dem Aufstieg Chinas – dürften die Verwirklichungskorridore für einen ernstgemeinten Kampf gegen den Klimawandel schwinden.

Die USA treiben ihre ureigene militärische Arktisstrategie unaufhörlich voran, Zugeständnisse sind maximal ausgereizt. Die Leitlinien von 2024 bedürfen einer grundlegenden Überarbeitung. Unter den aktuellen gesellschaftspolitisch-konservativen Vorzeichen birgt dies wenig Grund zur Freude.

Fraglich bleibt jedoch, ob der Sprung aus Washingtons Schatten eingeleitet wird, ob die regelbasierte Ordnung als zentrales ideologisches Dogma erhalten bleibt und ob umweltpolitische Akzentuierungen noch Eingang finden.

URL dieses Artikels:https://www.heise.de/-11163718

Links in diesem Artikel:[1] https://www.tagesschau.de/ausland/amerika/faq-groenland-rutte-trump-vereinbarung-daenemark-100.html[2] https://www.ipg-journal.de/rubriken/aussen-und-sicherheitspolitik/artikel/auf-duennem-eis-8826/[3] https://www.tagesschau.de/ausland/europa/eu-reaktion-usa-groenland-100.html[4] https://www.spiegel.de/politik/groenland-bundeskanzler-merz-verspricht-unterstuetzung-gegen-russische-bedrohung-a-e27c2318-6a83-4a65-b9c4-b3172c6603e5[5] https://www.auswaertiges-amt.de/resource/blob/2676012/35e32e524625a571390e1af8789b1fd7/arktis-leitlinien-data.pdf[6] https://www.swp-berlin.org/10.18449/2024A03/[7] https://www.bundestag.de/dokumente/textarchiv/2022/kw08-sondersitzung-882198[8] https://www.bundestag.de/presse/hib/kurzmeldungen-1021554[9] https://www.imi-online.de/2022/12/14/nukleare-altlasten-in-der-arktis/[10] https://www.kas.de/de/web/auslandsinformationen/artikel/detail/-/content/bodenschaetze-und-seewege-in-der-arktis[11] https://www.swp-berlin.org/10.18449/2025S19/[12] https://www.bmi.bund.de/SharedDocs/downloads/DE/veroeffentlichungen/2023/nationalesicherheitsstrategie.pdf?__blob=publicationFile&v=1[13] https://www.swp-berlin.org/10.18449/2023A26/[14] https://www.reuters.com/world/europe/eu-commission-working-package-support-arctic-security-von-der-leyen-says-2026-01-20/[15] https://de.euronews.com/2026/01/15/daenemark-bundeswehr-groenland-nato[16] https://web.de/magazine/politik/witz-italien-lehnt-arktis-mission-41794948[17] https://foreignpolicy.com/2026/01/22/carney-davos-trump-greenland-speech/[18] https://www.trtworld.com/article/bc70bd0bc002

Copyright © 2026 Heise Medien

Bernd Müller

(Bild: Roman Samborskyi / Shutterstock.com)

Wer Hausaufgaben von ChatGPT erledigen lässt, schneidet später schlechter ab – außer unter einer bestimmten Bedingung.

Viele Jugendliche greifen heute ganz selbstverständlich zu ChatGPT [1] oder anderen KI-Tools [2], wenn die Matheaufgaben zu schwer erscheinen oder der Aufsatz schnell fertig werden muss. Manche Lehrer berichten sogar, dass Schüler im Unterricht die KI-Hilfe in Anspruch nehmen, um die Aufgaben von Arbeitsblättern zu lösen.

Der Medienpädagogische Forschungsverbund Südwest geht in seiner JIM-Studie [3] davon aus, dass 62 Prozent der Schüler in Deutschland regelmäßig KI-Tools benutzen – meist für Hausaufgaben.

Bildungsexperten – nicht nur in Deutschland – zeigen sich über diesen Trend besorgt. Der Physiklehrer und Bildungsexperte Vincenzo Schettini aus Italien ist einer von ihnen. Was er in einem Interview erzählt, könnte genauso gut in Deutschland gewesen sein.

Eine Mutter erzählte ihm [4] demnach, ihr 14-jähriger Sohn habe ChatGPT benutzt, um einen Aufsatz über den Schriftsteller Alessandro Manzoni schreiben zu lassen – mit der besonderen Bitte an die KI, typische Fehler eines 14-Jährigen einzubauen.

Was Schettini dabei besonders beunruhigte: Die Mutter erzählte davon mit einer gewissen Leichtigkeit, als sei es keine große Sache. Doch für den Lehrer ist genau das der Kern des Problems. Der Schüler lerne weder das Schreiben noch das eigenständige Arbeiten. Die Folgen zeigen sich erst später.

So sagt Schettini:

"Wenn du mit 14 Jahren deine Hausaufgaben machen lässt, mit 20 nicht weißt, wie man eine E-Mail schreibt, an die Universität gehst und keine Methode hast, um eine Prüfung zu bewältigen, dann fliegst du wirklich raus. […] Dann gehst du weg, gehst zu einem Vorstellungsgespräch, weißt nicht, wie du vor einem Arbeitgeber sprechen sollst, das heißt, du findest dich plötzlich in der realen Welt wieder."

Auch wenn das etwas pessimistisch klingen mag, so bleibt die zentrale Frage für Schulen und Lehrkräfte: Unter welchen Bedingungen unterstützt KI das Lernen – und wann ersetzt sie es bloß?

Ein großes Feldexperiment der University of Pennsylvania mit knapp 1.000 High-School-Schülern liefert aufschlussreiche Ergebnisse [5]. Die Forscher teilten die Jugendlichen in drei Gruppen: ohne KI, mit freiem ChatGPT-Zugang und mit einem KI-Tutor, der so erstellt war, dass er Schritt-für-Schritt-Erklärungen, Hinweise und Reflexion bot.

Während der Übungsphase schnitten beide KI-Gruppen deutlich besser ab. Die freie ChatGPT-Nutzung brachte 48 Prozent bessere Ergebnisse, der angeleitete Tutor sogar 127 Prozent. Klingt nach einem klaren Erfolg – aber man sollte hier nicht voreilig sein.

Im anschließenden Test ohne KI-Zugang zeigte sich ein überraschendes Bild: Die Schüler mit freier KI-Nutzung schnitten 17 Prozent schlechter ab als jene, die nie Zugang hatten. Sie hatten die KI als "Krücke" benutzt und fertige Lösungen abgeschrieben, statt selbst zu denken.

Der speziell gestaltete KI-Tutor hingegen milderte diesen negativen Effekt weitgehend ab.

Nicht alle Studien kommen zu negativen Ergebnissen. Der entscheidende Unterschied liegt im Setting – also darin, wie und wofür die KI eingesetzt wird.

Negative Befunde häufen sich, wenn ChatGPT etwa direkt in Prüfungssituationen verwendet wird. In einer ungarischen Studie [6] durften Studierende die KI während einer Matheklausur nutzen. Das Ergebnis: mehr Durchfaller und weniger Spitzenleistungen.

Ähnliches zeigt ein Laborexperiment [7]: Besonders Lernende mit geringeren Vorkenntnissen erkannten falsche KI-Antworten nicht und übernahmen sie ungeprüft.

Positive Effekte zeigen sich dagegen, wenn KI als Lernwerkzeug in strukturierten Unterrichtsszenarien eingesetzt wird. Eine Studie [8] mit Elftklässlern in den Emiraten etwa nutzte ChatGPT vier Wochen lang als Lernhilfe im Physikunterricht – mit messbaren Leistungssteigerungen.

Auch Metaanalysen [9] bestätigen dieses Muster: Im Durchschnitt zeigen sich moderat positive Effekte auf die akademische Leistung – besonders bei klarer pädagogischer Einbettung und mittelfristigen Interventionen.

Wie also sollte KI im Unterricht eingesetzt werden? Die Forschung liefert klare Hinweise.

Erstens: Die Rolle der KI muss klar definiert sein. Sie sollte als Tutor fungieren, der Hinweise gibt und zur Reflexion anregt – nicht als Automat, der fertige Lösungen ausspuckt. Das entspricht dem erfolgreichen "GPT Tutor"-Ansatz aus der Penn-Studie.

Zweitens: Die Einbettung benötigt Struktur. Klare Lernziele, wiederholte Übungsphasen und regelmäßige Feedbackzyklen sind entscheidend. Eine einmalige "Abkürzung" bei den Hausaufgaben bringt keinen nachhaltigen Lerneffekt.

Drittens: KI-Antworten [10] müssen kritisch geprüft werden. Eine Studie zeigte [11], dass 32 Prozent der ChatGPT-generierten Hilfen die Qualitätsprüfung nicht bestanden. Techniken wie Selbstkonsistenz können Fehler reduzieren, funktionieren aber je nach Fach unterschiedlich gut.

Der Griff zur KI hat oft einen simplen Grund: Überlastung. Schettini beschreibt KI als "singende Sirene", deren Lockruf besonders für gestresste Jugendliche schwer zu widerstehen ist. "Sie haben so viele Hausaufgaben zu erledigen, dass sie irgendwann sagen: Oh Leute, ich nehme sie, lasse sie alles machen und wünsche allen einen guten Abend."

Sein Gegenvorschlag ist pragmatisch: weniger, aber gezieltere Hausaufgaben. Der eigentliche Leistungsnachweis sollte im Klassenzimmer stattfinden – ohne digitale Hilfsmittel. Dort zeigt sich, was Schüler wirklich können.

Entscheidend ist dabei die Abstimmung im Kollegium. Schettini appelliert an Lehrkräfte, in Klassenkonferenzen gemeinsam festzulegen, wie viele Hausaufgaben aufgegeben werden. Nur so lässt sich verhindern, dass die Gesamtlast Schüler in die Arme der KI treibt.

Für Schulen und Steuergruppen ergibt sich daraus ein klarer Entscheidungsrahmen. Die zentrale Unterscheidung lautet: kurzfristige Produktivität versus nachhaltiges Lernen.

Bessere Hausaufgaben und Übungsnoten sind kein Beweis für echten Kompetenzaufbau. Entscheidend ist, ob Schüler auch ohne KI-Unterstützung bestehen können. Das sollte das Maß aller Dinge sein.

Tool-Design und Nutzungsregeln sind dabei wichtige Stellhebel. Ohne Leitplanken drohen negative Lerneffekte. Mit klarem Scaffolding – also einer gestuften Lernunterstützung, die schrittweise zurückgenommen wird – und didaktischer Anleitung kann KI dagegen den Kompetenzaufbau unterstützen.

Schulen sollten sich fragen: In welchen Fächern ist KI-Nutzung besonders fehleranfällig? Mathematik und Programmierung etwa erfordern Präzision, die ChatGPT nicht immer liefert. Welche Kontrollen und Anleitungen sind nötig? Und wie kann das Kollegium gemeinsam tragfähige Regeln entwickeln?

Die Antwort auf die Frage, ob KI beim Lernen hilft, ist weder ein klares Ja noch ein klares Nein. Es kommt darauf an – auf das Setting, die Anleitung und die didaktische Einbettung. Wer das versteht, kann KI vom Risiko zur Chance machen.

URL dieses Artikels:https://www.heise.de/-11163648

Links in diesem Artikel:[1] https://www.heise.de/tp/article/ChatGPT-liest-mit-Wie-privat-sind-unsere-Gespraeche-mit-KI-10631607.html[2] https://www.heise.de/tp/article/KI-im-Bildungssystem-Vom-Tabu-zum-Erfolgsrezept-10251222.html[3] https://mpfs.de/app/uploads/2024/11/JIM_2024_PDF_barrierearm.pdf[4] https://www.orizzontescuola.it/chatgpt-a-scuola-vincenzo-schettini-se-a-14-anni-ti-fai-fare-i-compiti-dallai-la-resa-dei-conti-arriva-quando-ormai-e-troppo-tardi-per-recuperare/[5] https://www.pnas.org/doi/10.1073/pnas.2422633122[6] https://doi.org/10.63684/dk.2025.02.02[7] https://doi.org/10.1080/13504851.2024.2337330[8] https://www.cedtech.net/download/chatgpt-revolutionizing-student-achievement-in-the-electronic-magnetism-unit-for-eleventh-grade-13417.pdf[9] https://doi.org/10.1111/jcal.70096[10] https://www.heise.de/tp/article/Kann-man-KI-Antworten-ueberhaupt-noch-trauen-11114709.html[11] https://journals.plos.org/plosone/article?id=10.1371/journal.pone.0304013

Copyright © 2026 Heise Medien

Marcel Kunzmann

Eine Einigung beim Heizungsgesetz ist noch nicht in Sicht

(Bild: holgers.pictures/Shutterstock.com)

Die Koalition sollte bis Ende Januar Eckpunkte für ein neues Heizungsgesetz vorlegen. Doch eine Einigung ist nicht in Sicht. Die Gründe sind vielschichtig.

Die schwarz-rote Koalition hat ihre selbst gesetzte Frist zur Reform des Heizungsgesetzes verpasst. Bis Ende Januar sollten Eckpunkte für das geplante "Gebäudemodernisierungsgesetz" vorliegen, doch Union und SPD konnten sich nicht einigen. Nach Informationen [1] des ARD-Hauptstadtstudios ist auch für die kommende Woche eine Einigung alles andere als sicher.

Aus Unionskreisen wurde der Klimazeitung bestätigt [2], es sei "völlig offen", ob eine Verständigung bis Anfang Februar gelingen kann.

Die Verhandlungen sind hochrangig besetzt. Neben den Fraktionsvorsitzenden Jens Spahn (CDU) und Matthias Miersch (SPD) war auch Energieministerin Katherina Reiche (CDU) bei mehreren Treffen persönlich dabei, wie die Tagesschau berichtet.

Offiziell eingebunden ist auch das Bauministerium, dessen Ministerin Verena Hubertz sich aufgrund ihres Mutterschutzes vertreten lässt. Der Fraktionsvize der Union, Sepp Müller, sagte: "Wir nehmen uns die Zeit, die wir benötigen, damit wir den Menschen auch eine Zukunftsperspektive geben können, wie sie zukünftig heizen." Aus dem Wirtschaftsministerium heißt es laut Tagesschau, man brauche noch etwas Zeit und sei optimistisch, dass bald Eckpunkte vorliegen.

Ein zentrales Hindernis in den Verhandlungen sind die gesetzlich verankerten Klimaziele. Deutschland muss bis 2045 klimaneutral werden, also die Treibhausgasemissionen rechnerisch auf Null bringen. Bundesumweltminister Carsten Schneider (SPD) pocht darauf, dass das Gesetz so geändert wird, dass die Klimaziele erreicht werden können. Bis spätestens Ende März muss Schneider zudem ein neues Programm vorlegen, das alle Klimaschutzmaßnahmen der Bundesregierung auflistet.

Die juristische Lage erschwert die Verhandlungen zusätzlich. Die Deutsche Umwelthilfe bekam kürzlich mit einer Klage Recht [3]. Das Bundesverwaltungsgericht stellte fest, dass die bisherigen Klimaschutzmaßnahmen nicht ausreichen, um die Klimaziele zu erreichen. Die Bundesregierung muss ihre Bemühungen also verstärken, statt abschwächen. Das sogenannte Heizungsgesetz einfach ersatzlos abschaffen, ist deshalb kaum möglich, wie die Tagesschau berichtet.

Auch die EU setzt einen zeitlichen Rahmen: Bis Ende Mai muss die EU-Gebäuderichtlinie EPBD [4] in einzelstaatliches Recht umgesetzt werden, berichtet die Klimazeitung. Das EU-Gesetz verpflichtet die Mitgliedsstaaten, die Energieeffizienz bestehender Gebäude zu verbessern und sie bis 2050 klimafrei zu gestalten.

Der zweite zentrale Stolperstein ist die konkrete Ausgestaltung des Gesetzes. Im Zentrum steht die Vorgabe, dass die Wärme einer neuen Heizung zu mindestens 65 Prozent aus erneuerbaren Energien kommen muss. CDU-Fraktionschef Jens Spahn sagte [5] noch im Dezember: "Die 65 Prozent müssen weg".

Die SPD argumentiert hingegen, der Klimaschutz im Gebäudesektor brauche verlässliche Leitplanken, sonst drohten höhere Emissionen und langfristig steigende Heizkosten. Umweltminister Schneider will an der zentralen Regelung festhalten. "Es bleibt dabei, dass neue Heizungen 65 Prozent erneuerbare Energien nutzen müssen", sagte er [6] laut Frankfurter Rundschau auf dem Energiewende-Kongress der Deutschen Energie-Agentur.

Streicht oder senkt man diesen Wert, droht die Wirkung des Gesetzes zu verpuffen. Claudia Kemfert, Energieexpertin des Deutschen Instituts für Wirtschaftsforschung, sagte: "Entscheidend für eine Neufassung ist, nicht die Ambition aufzugeben, sondern sie mit klaren, sozial ausgewogenen Förderregeln und realistischen Zeitpfaden zu unterlegen."

Auch Fachleute sprechen sich für die Beibehaltung der 65-Prozent-Regel aus. Markus Fritz vom Fraunhofer-Institut für System- und Innovationsforschung sagte laut Klimazeitung, die Vorgabe sei "essenziell, um die Lücke zum Ziel der Klimaneutralität im Jahr 2045 zu reduzieren". Würde diese Regelung zeitlich verschoben, müssten zur Kompensation entweder der Preis für Erdgas und Heizöl stärker erhöht oder die Förderung für den Heizungstausch angehoben werden.

Ein Bündnis von 14 Organisationen, darunter der Deutsche Städte- und Gemeindebund, der Bundesverband der Energie- und Wasserwirtschaft und der Bundesverband Wärmepumpen, hat die Regierung aufgefordert [7], die Hängepartie zu beenden. "Verzögerungen schaden letztlich allen und schaffen weitere Unsicherheiten bei Kommunen, Unternehmen und Bürgern", heißt es in dem Appell von letzter Woche.

Grundsätzlich sprechen sich die Verbände für die 65-Prozent-Regel aus. Sie sei "dazu geeignet, einen schnellen Hochlauf der erneuerbaren Energien weiter zu unterstützen, um einen klimaneutralen Gebäudebestand zu erreichen".

Umweltminister Schneider mahnte zur Eile [8]: "Von den Heizungsbauern über die Installateure bis zur Energiewirtschaft und den kommunalen Spitzenverbänden rufen alle: Stiftet kein neues Chaos, ändert möglichst wenig, und schafft endlich Planungssicherheit."

Ein weiterer Streitpunkt ist die Ausgestaltung der staatlichen Förderung. Vor allem der SPD ist die Unterstützung von Haushalten mit niedrigem Einkommen wichtig. Sie hatte in den Koalitionsvertrag verhandelt, dass die Heizungsförderung im Grundsatz erhalten bleibt und will erreichen, dass besonders einkommensschwache Haushalte von staatlichen Zuschüssen profitieren, berichtet die Tagesschau.

Schneider kündigte Änderungen bei der staatlichen Förderung an. Die Zuschüsse sollen stärker nach sozialen Kriterien vergeben werden. "Das Ergebnis war, dass besonders viel Geld bei den oberen zehn Prozent gelandet ist. Das hat viele Leute zurecht kiebig gemacht", sagte er laut Frankfurter Rundschau.

Stefan Thomas vom Wuppertal Institut für Klima, Umwelt, Energie sprach sich gegenüber der Klimazeitung dafür aus, die Förderung für Mietwohnungen, die derzeit maximal 35 Prozent beträgt, anzuheben, um den Umstieg auf klimafreundliche Heizungen auch in diesem Bereich zu beschleunigen. Bisher können Hauseigentümer 70 Prozent Zuschüsse erhalten, wenn das Haushaltseinkommen unter 40.000 Euro im Jahr liegt.

Die anhaltende Unsicherheit schlägt sich bereits massiv in den Verkaufszahlen nieder. Im vergangenen Jahr wurden nach Berechnungen des Verbandes BDH so wenige Heizungen installiert wie seit 15 Jahren nicht mehr. Insgesamt 627.000 Anlagen – 12 Prozent weniger als im bereits schwachen Vorjahr. Gasbrennwertkessel brachen um 36 Prozent auf 229.000 Stück ein, Ölheizungen auf nur noch 22.500, wie die Frankfurter Rundschau berichtet.

Gleichzeitig wurden 2025 erstmals mehr Wärmepumpen verbaut als Gasheizungen. Mit 299.000 installierten Heizungs-Wärmepumpen stieg der Absatz um 55 Prozent – auch dank staatlicher Förderung. BDH-Hauptgeschäftsführer Markus Staudt warnte laut Frankfurter Rundschau vor "personellen Maßnahmen" wie Stellenabbau, sollten nicht bald stabile Regeln kommen.

Heizungsbauer Lutz Spring aus dem brandenburgischen Oranienburg sagte gegenüber der Tagesschau: "Wir können einfach nicht mehr. Ich habe keine Lust mehr auf dieses Theater." Mit seiner Firma verbaut er im Schnitt jede Woche zwei Wärmepumpen. Eigentlich müsste er jetzt in Betriebsvergrößerung investieren, doch angesichts der Unsicherheit zögere er.

Besonders brisant ist die Situation in Großstädten. In Kommunen mit mehr als 100.000 Einwohnern wird der Einbau von Heizungen mit mindestens 65 Prozent erneuerbarer Energien bereits nach dem 30. Juni 2026 verbindlich, berichtet die Frankfurter Rundschau. Dies betrifft rund 80 Städte wie Berlin, Hamburg, München und Köln. Noch schneller kann es gehen, wenn eine Kommune ihre Wärmeplanung abgeschlossen hat – bereits 38 Prozent der großen Kommunen sind so weit.

Das Gesetz ist technologieoffen: Neben Wärmepumpen gelten auch Infrarotheizungen, Biomasseheizungen wie Pelletöfen, Solarthermie-Hybridheizungen oder der Anschluss an Wärmenetze als Erfüllung der 65-Prozent-Regel, berichtet die Frankfurter Rundschau. Selbst Gasheizungen bleiben möglich, wenn sie nachweislich erneuerbare Gase nutzen.

In einem Punkt haben sich Union und SPD bereits geeinigt. Fest steht laut Tagesschau: Das alte Gebäudeenergiegesetz wird einfach umbenannt. Neuer Titel: Gebäudemodernisierungsgesetz. Ob es bei einer bloßen Umbenennung bleibt oder sich die Koalition doch noch auf inhaltliche Eckpunkte einigen kann, ist bislang völlig offen.

URL dieses Artikels:https://www.heise.de/-11163445

Links in diesem Artikel:[1] https://www.tagesschau.de/inland/innenpolitik/heizungsgesetz--aenderung-koalition-100.html[2] https://klimareporter.de/gebaeude/neues-heizungsgesetz-in-der-warteschleife[3] https://www.duh.de/presse/pressemitteilungen/pressemitteilung/deutsche-umwelthilfe-erzielt-grundsatzurteil-fuer-den-klimaschutz-bundesverwaltungsgericht-verurteil/[4] https://www.dabonline.de/bautechnik/eu-gebaeuderichtlinie-epbd-faq/[5] https://www.stern.de/news/spahn-zu-heizungsgesetz--es-darf-keinen-zwang-bei-heizungen-im-bestand-geben-36958470.html[6] https://www.fr.de/verbraucher/chaos-um-heizungsgesetz-merz-regierung-laesst-frist-verstreichen-was-verbraucher-wissen-muessen-94152108.html[7] https://www.dstgb.de/publikationen/pressemitteilungen/gemeinsame-forderung-nach-schneller-klarheit-und-planungssicherheit/[8] https://www.zdfheute.de/wirtschaft/heizung-absatz-verkauf-rueckgang-bdh-waermepumpe-100.html

Copyright © 2026 Heise Medien

(Bild: Raspberry Pi Plc.)

Der Raspi-Hersteller erhöht wegen des teuren Speichers noch mal die Preise. Das Topmodell Raspberry Pi 5 steigt auf über 200 Euro.

Die Preise für fast alle Raspberry-Pi-Einplatinencomputer steigen deutlich an. Die Raspberry Pi Plc. erhöht die Preisempfehlungen fast aller Modelle mit mindestens 2 GByte Speicher, vom Raspberry Pi 4 und 5 über die Compute Modules bis hin zu den Tastatur-PCs Raspberry Pi 500 [1] und 500+ [2]. Grund sind die steigenden Kosten für den aufgelöteten Arbeitsspeicher.

| Preissteigerungen bei Raspis | |

| Speicherkapazität | Preissteigerung |

| 1 GByte | - |

| 2 GByte | 10 US-Dollar |

| 4 GByte | 15 US-Dollar |

| 8 GByte | 30 US-Dollar |

| 16 GByte | 60 US-Dollar |

Die Preissteigerungen sind relativ und absolut noch stärker als bei der vorangegangenen Anpassung im Dezember 2025 [3]. Je mehr Speicher ein Raspi hat, desto stärker zieht der Preis laut Ankündigung an [4]. Das Raspi-5-Topmodell mit 16 GByte RAM steigt von zuletzt 145 auf jetzt 205 US-Dollar, ein Plus von gut 41 Prozent.

Schielt man auf den Preis der 1-GByte-Version für gleichbleibend 45 Dollar, wird klar: Beim Raspi 5 mit 16 GByte macht allein der Speicher über drei Viertel des Preises aus. Beim 8-GByte-Modell für jetzt 125 statt 95 Dollar sind es etwa zwei Drittel. Die Raspis mit 2 und 4 GByte RAM erscheinen derzeit am attraktivsten für Bastelprojekte. Der Raspi 4 ist noch etwas günstiger erhältlich als der Raspi 5.

Die Euro-Preise inklusive Mehrwertsteuer (in US-Preisen nicht enthalten) lassen sich fast eins zu eins von den Dollar-Preisen ableiten, wenn sich die Händler an die Empfehlungen halten. Ein Raspi 5 mit 4 GByte RAM bleibt damit noch unter der 100-Euro-Marke. Dessen neue Preisempfehlung liegt bei 85 Dollar.

Für die 16-GByte-Version (ab 209,90 €) [5] gilt das nicht, da diese bereits ausverkauft ist. Sie nähert sich im Handel abseits von kleinen Amazon- und Ebay-Shops den 300 Euro. Der Hersteller ist hier an einen einzigen Zulieferer gebunden, da es sich um eine Einzelanfertigung für das Raspi-Board handelt.

Bei den 3er-Raspis und den Miniversionen der Serie Raspberry Pi Zero nimmt der Hersteller keine Preisanpassungen vor. Sie verwenden alten LPDDR2-Speicher, von dem die Firma derzeit genug für mehrere Produktionsjahre auf Vorrat hat.

Die Raspberry Pi Plc. will die Preise wieder senken, sobald sich die Liefersituation beim Speicher bessert. Bis das passiert, kann allerdings noch einige Zeit vergehen.

URL dieses Artikels:

https://www.heise.de/-11162382

Links in diesem Artikel:

[1] https://www.heise.de/tests/Im-Test-Raspberry-Pi-500-im-Tastaturgehaeuse-und-Raspi-Monitor-10190567.html

[2] https://www.heise.de/tests/Raspberry-Pi-500-mit-beleuchteter-mechanischer-Tastatur-und-SSD-im-Test-10657090.html

[3] https://www.heise.de/news/Raspberry-Pi-4-und-5-werden-teurer-11098873.html

[4] https://www.raspberrypi.com/news/more-memory-driven-price-rises/

[5] https://preisvergleich.heise.de/raspberry-pi-5-modell-b-a3383358.html?cs_id=1206858352&ccpid=hocid-newsticker

[6] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[7] https://www.heise.de/newsletter/anmeldung.html?id=ki-update&wt_mc=intern.red.ho.ho_nl_ki.ho.markenbanner.markenbanner

[8] mailto:mma@heise.de

Copyright © 2026 Heise Medien

(Bild: MGM)

Im Februar zeigt Netflix alle Staffeln von "Stargate SG-1". Bei Amazon Prime ist "The Life Of Chuck" im Programm und bei Disney+ läuft "Inglourious Basterds".

Der Februar hat unter anderem Film- und Serien-Highlights wie Tarantinos "Inglourious Basterds", die kultige SciFi-Serie "Stargate SG-1" sowie die Tragikomödie "The Life Of Chuck" im Gepäck.

Ab dem 15. Februar 2026 zeigt Netflix [1] alle 10 Staffeln der beliebten Science-Fiction-Serie "Stargate SG-1", die zwischen 1997 und 2007 produziert und erstmals veröffentlicht wurde. Die Serie basiert auf dem Film "Stargate", der 1994 in den Kinos lief, und handelt von der geheimen militärischen Spezialeinheit "SG-1", die aus Soldaten und Wissenschaftlern besteht. Zu der Einheit gehören unter anderem Colonel Jack O’Neill (Richard Dean Anderson), Dr. Samantha Carter (Amanda Tapping), Teal'c (Christopher Judge) und Dr. Daniel Jackson (Michael Shanks).

Mithilfe des namensgebenden Sternentors (Stargate) können die Mitglieder von "SG-1" über eine Wurmlochverbindung innerhalb weniger Sekunden zu Stargates reisen, die sich auf anderen Planeten befinden. Colonel Jack und seine Kollegen sollen auf fremden Planeten nach unbekannten Zivilisationen und fortschrittlicher Technik suchen, was dazu führt, dass der Trupp immer wieder Konflikte entfacht oder in vor Ort bereits bestehende Konflikte hineingezogen wird. Bereits zu Beginn der Serie wird schnell klar, dass die feindseligen "Goa’uld" eine Bedrohung für die Erde darstellen, sodass SG-1 auch kontinuierlich nach Verbündeten auf den bereisten Planeten sucht. Im Herbst 2025 wurde angekündigt, dass eine neue "Stargate"-Serie gegen Ende 2026 für Amazon in die Produktion gehen wird.

Die Tragikomödie "The Life Of Chuck" ist die Verfilmung der Kurzgeschichte "Chucks Leben" aus Stephen Kings Novellensammlung "Blutige Nachrichten". Das Besondere an "The Life Of Chuck" ist, dass die Geschichte des titelgebenden Protagonisten Charles "Chuck" Krantz (Tom Hiddleston) rückwärts erzählt wird. Chuck wächst nach dem Tod seiner Eltern bei seinen Großeltern auf. Während sein Großvater Albie Krantz (Mark Hamill) ihn dazu drängt, wie er selbst Buchhalter zu werden, geht Chuck seiner Tanz-Leidenschaft nach, die er von seiner Großmutter Sarah Krantz (Mia Sara) geerbt hat.

Als er eines Tages auf den stets verschlossenen Dachboden seines Wohnhauses geht, obwohl es ihm von Albie verboten worden war, hat Chuck eine geisterhafte Begegnung mit seinem Zukunfts-Ich. Dieses Ereignis hat großen Einfluss auf sein weiteres Leben und ohne Chucks Wissen auch auf das vieler anderer Menschen. Zu Beginn des Films wird gezeigt, wie die Erde in nicht allzu ferner Zukunft kurz vor ihrem Ende steht, nachdem Naturkatastrophen und Epidemien die Welt zu einem nahezu unbewohnbaren Ort gemacht haben. Diese Ereignisse scheinen auf seltsame Weise mit einem Mann namens Charles "Chuck" Krantz verbunden zu sein. Der Film ist ab dem 09. Februar 2026 bei Amazon Prime Video [3] zu sehen.

Quentin Tarantinos "Inglourious Basterds" findet in einem fiktiven Szenario während des 2. Weltkriegs statt und erzählt über fünf Kapitel eine ebenso brutale wie spannende Kriegsgeschichte mit alternativen Fakten und Wendungen. Im Zentrum der Handlung steht einerseits die jüdische Kinobetreiberin Shosanna Dreyfus (Mélanie Laurent) und andererseits die berüchtigte jüdische Kampftruppe "Basterds" unter der Führung von Lieutenant Aldo Raine (Brad Pitt). Shosanna will sich an den Nazis rächen, da diese ihre Familie ermordet haben, während Aldo und seine Männer hinter feindlichen Linien in Frankreich so viele Nazis wie möglich überfallen und töten wollen.

Die Wege von Shosanna und Aldo kreuzen sich in einem fulminanten Finale, bei dem beide Parteien unabhängig voneinander die Auslöschung der gesamten NS-Führungsriege, inklusive Adolf Hitler, geplant haben. Shosanna und Aldo haben mit dem SS-Offizier Hans Landa (Christoph Waltz) den gleichen, skrupellosen und äußerst scharfsinnigen Widersacher, den es für die Umsetzung der Attentatspläne zu überwinden gilt. "Inglourious Basterds" läuft ab dem 01. Februar 2026 bei Disney+ [7].

Die folgende Tabelle zeigt alle neuen Filme und Serien, die im Februar bei Netflix, Disney+ und Amazon Prime Video erscheinen und im Abopreis inbegriffen sind. Titel, die bei Amazon ausschließlich zum Einzelkauf oder zum Leihen verfügbar werden, sind nicht angegeben.

| Disney+ | Release |

| Filme | |

| Ich – Einfach unverbesserlich 1+2 | 01.02. |

| E.T. – Der Außerirdische | 01.02. |

| Inglourious Basterds | 01.02. |

| Notting Hill | 01.02. |

| Jerry Maguire – Spiel des Lebens | 01.02. |

| Jumanji | 01.02. |

| Die Hochzeit meines Besten Freundes | 01.02. |

| Grindhouse: Planet Terror | 01.02. |

| Jackie Brown | 01.02. |

| Kill Bill: Volume 1+2 | 01.02. |

| Reservoir Dogs | 01.02. |

| Du & Ich und Alle reden mit | 01.02. |

| Hook | 02.02. |

| Ella McCay | 05.02. |

| Max und die wilde 7 – Die Geister-Oma | 06.02. |

| Stay | 13.02. |

| Love Story: John F. Kennedy Jr. & Carolyn Bessette | 13.02. |

| Searchlight Pictures "In the Blink of an Eye" | 27.02. |

| Morbius | 28.02. |

| Serien | |

| Schitt’s Creek: Staffel 1-6 | 02.02. |

| Die Muppet Show | 04.02. |

| Beyond Paradise: Staffel 3 | 04.02. |

| We Call It Imagineering: Staffel 1 | 04.02. |

| The Artful Dodger: Staffel 2 | 10.02. |

| The Scream Murder: A True Teen Horror Story: Staffel 1 | 11.02. |

| Himmel, Herrgott, Sakrament: Staffel 1 | 18.02. |

| Die achte Familie: Sekizinci Aile: Staffel 1 | 18.02. |

| Schloss Einstein: Staffel 20-23 | 18.02. |

| Das Geheimnis des Totenwaldes: Staffel 1 | 18.02. |

| Girl on the Run: The Hunt for America’s most wanted Woman: Staffel 1 | 19.02. |

| Watching You: Staffel 1 | 20.02. |

| Paradise: Staffel 2 | 23.02. |

| Amazon | Release |

| Filme | |

| Fargo - Blutiger Schnee | 01.02. |

| Glam Girls - Hinreißend verdorben | 01.02. |

| Licorice Pizza | 01.02. |

| After | 01.02. |

| After Love | 01.02. |

| After Truth | 01.02. |

| Ein ganzes halbes Jahr | 01.02. |

| Bad Boy And Me | 03.02. |

| William Tell | 04.02. |

| Relationship Goals | 04.02. |

| Fabian und Die mörderische Hochzeit | 06.02. |

| Natürliches Gleichgewicht: Die Vision eines Königs | 06.02. |

| Noah | 06.02. |

| Jumper | 06.02. |

| F*Ck Valentine's Day | 07.02. |

| Das perfekte Geheimnis | 07.02. |

| Hellboy: The Crooked Man | 09.02. |

| The Life Of Chuck | 09.02. |

| Love Me Love Me | 13.02. |

| After Ever Happy | 13.02. |

| Manta Manta | 16.02. |

| Borderlands | 22.02. |

| Boneyard | 24.02. |

| Meet Cute – Mein täglich erstes Date | 25.02. |

| The Bluff | 25.02. |

| Man On The Run | 27.02. |

| Hit Man (2023) | 27.02. |

| Inheritance - Ein dunkles Vermächtnis | 28.02. |

| The Creator | 28.02. |

| Serien | |

| LOL: Last One Laughing Brazil: Staffel 5 | 06.02. |

| Cross: Staffel 2 | 11.02. |

| Soul Power: The Legend Of The American Basketball Association: Staffel 1 | 12.02. |

| Jesy Nelson: Life After Little Mix: Staffel 1 | 13.02. |

| 56 Tage: Staffel 1 | 18.02. |

| The CEO Club: Staffel 1 | 23.02. |

| Final Siren: Inside The Afl: Staffel 1 | 27.02. |

| Diverse NBA-Spiele | Februar |

| Netflix | Release |

| Filme | |

| Für immer Liebe | 01.02. |

| Glitter & Gold: Die Welt erfolgreicher Eistanzpaare | 01.02. |

| Ist das Kuchen? Valentinstag | 04.02. |

| Yoh! Bestie | 06.02. |

| Die Königin des Schachs | 06.02. |

| Longlegs | 08.02. |

| Matter of Time | 09.02. |

| This is I | 10.02. |

| Mission: Impossible - Dead Reckoning | 10.02. |

| Brotherhood: Angstzustand | 11.02. |

| The French Dispatch | 12.02. |

| Die Royal Tenenbaums | 12.02. |

| Darjeeling Limited | 12.02. |

| Joe's College Road Trip | 13.02. |

| Ich weiß, was du letzten Sommer getan hast | 16.02. |

| Being Gordon Ramsay | 18.02. |

| Die schwedische Verbindung | 19.02. |

| Pavane | 20.02. |

| Firebreak | 20.02. |

| Serien | |

| Bones: Die Knochenjägerin Staffel 1-4 | 01.02. |

| Mo Gilligan: In The Moment | 03.02. |

| Unfamiliar | 05.02. |

| The Lincoln Lawyer: Staffel 4 | 05.02. |

| Die Löwinnen | 05.02. |

| Salvador | 06.02. |

| Die tierischen Fälle von Kit und Sam: Kapitel 7 | 09.02. |

| Motorvalley | 10.02. |

| Kohrra: Staffel 2 | 11.02. |

| Die Bleikinder | 11.02. |

| Love Is Blind: Staffel 10 | 11.02. |

| How To Get To Heaven From Belfast | 12.02. |

| Million-Follower Detective | 12.02. |

| Das Museum der Unschuld | 13.02. |

| The Art of Sarah | 13.02. |

| Im Dreck: Staffel 2 | 13.02. |

| Stargate SG-1: Staffel 1-10 | 15.02. |

| Sommore: Chandelier Fly | 17.02. |

| The Night Agent: Staffel 3 | 19.02. |

| Strip Law – Die Gesetze von Las Vegas | 20.02. |

| Taylor Tomlinson: Prodigal Daughter | 24.02. |

| Kacken an der Havel | 26.02. |

| Bridgerton: Staffel 4 Teil 2 | 26.02. |

| BAKI-DOU: The Invincible Samurai | 26.02. |

| Formula 1: Drive to Survive: Staffel 8 | 27.02. |

Auch interessant:

VPN Test 2025: Die besten VPN-Anbieter im Vergleich [12] bei heise Download

URL dieses Artikels:

https://www.heise.de/-11162642

Links in diesem Artikel:

[1] https://www.netflix.com/de/

[2] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[3] https://amzn.to/2KFoRFF

[4] https://www.heise.de/download/specials/Anonym-surfen-mit-VPN-Die-besten-VPN-Anbieter-im-Vergleich-3798036?wt_mc=intern.red.download.vpn-anbieter-test-vergleich.ticker.streamingvorschau.streamingvorschau

[5] https://www.heise.de/download/specials/Anonym-surfen-mit-VPN-Die-besten-VPN-Anbieter-im-Vergleich-3798036?wt_mc=intern.red.download.vpn-anbieter-test-vergleich.ticker.streamingvorschau.streamingvorschau

[6] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[7] https://clkde.tradedoubler.com/click?p=304625&a=1475212&g=24738826

[8] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[9] https://clkde.tradedoubler.com/click?p=304625&a=1475212&g=24738826

[10] https://www.netflix.com/de/

[11] https://amzn.to/2KFoRFF

[12] https://www.heise.de/download/specials/Anonym-surfen-mit-VPN-Die-besten-VPN-Anbieter-im-Vergleich-3798036?wt_mc=intern.red.download.vpn-anbieter-test-vergleich.ho.ticker.ticker

[13] mailto:sem@heise.de

Copyright © 2026 Heise Medien

SpaceX hat am 2. Februar 2026 d ie Übernahme von xAI angekündigt . Das Ziel klingt radikal: KI-Rechenleistung soll künftig aus dem Weltraum statt von der Erde kommen. Elon Musks Raumfahrtfirma will damit das größte Problem der KI-Industrie lösen – den explodierenden Energiebedarf.

Heutige KI-Infrastruktur stößt an ihre Grenzen. Die Rechenzentren verbrauchen enorm viel Strom und müssen aufwendig gekühlt werden. Das musste auch xAI feststellen und laute, energiefressende und umweltschädliche Stromgeneratoren betreiben, um sein Rechenzentrum versorgen zu können.

Laut SpaceX lässt sich der Betrieb solcher irdischen Rechenzentren nicht mehr skalieren, ohne Stromnetze zu überlasten und die Umwelt zu schädigen. Die Übernahme verbindet mehrere Geschäftsfelder der beiden Unternehmen: KI-Entwicklung, Raketenstarts, Satelliteninternet und Social Media.

Die Lösung soll im Orbit liegen. Satelliten im All erhalten konstante Sonneneinstrahlung – keine Wolken, keine Nacht. Nach dem Start fallen kaum noch Betriebskosten an. SpaceX rechnet damit, dass weltraumbasierte KI-Rechenzentren in zwei bis drei Jahren günstiger werden als irdische Alternativen.

Das Konzept braucht nach Angaben von Elon Musk Hunderttausende neue Satelliten. Hier kommt Starship ins Spiel. Die neue Rakete kann 200 Tonnen Nutzlast pro Start transportieren und eine ganze Reihe von Satelliten transportieren und aussetzen. SpaceX hat schon einmal einen Antrag bei der US-Regulierungsbehörde FCC eingereicht hat

Jeder Starship-Start würde die 20-fache Transportkapazität eines Falcon-Starts bieten. SpaceX kalkuliert mit 100 Gigawatt zusätzlicher KI-Rechenleistung pro Jahr, die damit aufgebaut werden können.

SpaceX beziehungsweise Elon Musk denkt schon weiter. Mondbasen sollen zusätzliche Satelliten aus lokalen Ressourcen produzieren. Ein elektromagnetischer Massenbeschleuniger auf dem Mond könnte jährlich 500 bis 1.000 Terawatt an KI-Satelliten ins All schießen, wobei das eher nach Science-Fiction klingt als ein ernsthaftes Projekt.

In großen C++-Codebasen entscheiden Struktur, Benennung und klare Verantwortlichkeiten darüber, ob Änderungen schnell nachvollziehbar bleiben. Moderne Sprachfeatures erhöhen die Ausdruckskraft, können aber auch Komplexität und schwer erkennbare Abhängigkeiten verstärken.

Clean-Code-Prinzipien schaffen ein gemeinsames Vokabular für Reviews, Refactoring und Architekturentscheidungen. Wo Lesbarkeit, Fehlerbehandlung und Ressourcenmanagement konsequent umgesetzt sind, sinkt der Aufwand für Wartung und Erweiterungen.

Um diese Ansätze in C++ praxisnah zu vertiefen, bietet die Golem Karrierewelt den Live-Remote-Workshop " C++ Clean Code – Best Practices für Programmierer: virtueller Zwei-Tage-Workshop " am 18.-19. März 2026 an. Inhalte sind unter anderem KISS, DRY und SOLID, Prefer Composition over Inheritance, Law of Demeter sowie der Umgang mit Premature Optimization und Code Smells.

Ein Schwerpunkt liegt auf den C++ Core Guidelines, etwa zu Interfaces, Klassen, Smart Pointern, Concurrency und Error Handling. Ergänzend werden Patterns und Idioms wie RAII, Pimpl und CRTP sowie typische Anti-Patterns und Decoupling-Ansätze diskutiert.

Vorausgesetzt werden solide Kenntnisse in modernem C++; benötigt wird ein eigener Rechner mit C++-Compiler (mindestens C++ 17). Das Seminar findet virtuell auf Deutsch statt, Folien und Fachausdrücke sind in Englisch; nach Abschluss wird eine Teilnahmebestätigung ausgestellt.

Wer sich vor dem Kauf für den kostenlosen Newsletter der Golem Karrierewelt anmeldet, erhält 10 Prozent Rabatt auf die erste Bestellung bei der Golem Karrierewelt.

Sobald es kalt wird, verschiebt sich der Getränkebedarf in Richtung heiß und schnell wärmend. Wasserkocher werden entsprechend häufig genutzt, ebenso Wärmflaschen. Der Wasserkocher von Philips ist auf Häufigkeit ausgelegt. Die 1,7-Liter-Kapazität macht sich vor allem dann bemerkbar, wenn er mehrfach hintereinander verwendet wird.

Das Fassungsvermögen reicht für mehrere Tassen oder für eine volle Wärmflasche, ohne dass direkt wieder nachgefüllt werden muss. Das Edelstahlgehäuse wirkt stabil, steckt häufige Nutzung gut weg und bleibt auch nach längerer Zeit unauffällig. Der Wasserkocher von Philips ist kein Designobjekt, sondern ein Gerät, das funktionieren soll.

Im Inneren arbeitet ein verdecktes, flaches Heizelement. Laut Hersteller bringt es das Wasser zügig zum Kochen. Gleichzeitig hat diese Bauweise einen praktischen Nebeneffekt: Kalk setzt sich weniger an problematischen Stellen ab. Die Reinigung bleibt überschaubar, das Gerät wirkt weniger wartungsintensiv als Modelle mit offenliegenden Heizspiralen.

Der integrierte Mikro-Sieb-Filter soll Kalkpartikel bis zu 200 Mikrometer aus dem Wasser filtern. Das ist kein Feature, über das man viel nachdenkt, macht sich aber bemerkbar, wenn das Wasser klar bleibt und es keine Rückstände in der Tasse gibt. Der Filter lässt sich entnehmen und reinigen, ohne dass Ersatzteile oder Verbrauchsmaterialien nötig sind.

Auch der Sprungdeckel ist funktional gedacht. Er kann weit geöffnet werden, das erleichtert das Befüllen und Reinigen. Gleichzeitig soll der Kontakt mit aufsteigendem Dampf reduziert werden. Beim Thema Sicherheit setzt Philips auf ein mehrstufiges System mit Trockengehschutz und automatischer Abschaltung. Auf diese Weise ist der Wasserkocher nicht mehr in Betrieb, wenn er leer ist oder der Kochvorgang abgeschlossen wurde. Ergänzt wird das durch eine Tassenanzeige, die hilft, nur die benötigte Wassermenge zu erhitzen. Gemäß Hersteller kann damit Energie eingespart werden.

Der Wasserkocher von Philips kostet bei Amazon 27,98 Euro, erhält einer 4,5-von-5-Sterne-Bewertung und ist der Bestseller unter den Wasserkochern .

Reklame

Philips Daily Collection Metall Wasserkocher – 1,7L, Leuchtanzeige, 360°-Basis, Mikro-Sieb-Filter, Flaches Heizelement, Sprungdeckel, Energiesparend, Sicheres Design, Schnelles Aufkochen (HD9350/90)

44 % Rabatt sichernWeitere Wasserkocher im Angebot gibt es hier.

Dieser Artikel enthält sogenannte Affiliate-Links. Wenn Sie die Produkte über diese Links kaufen, erhält Golem eine kleine Provision. Dies hat keinen Einfluss auf den Preis der Artikel.

Kai Imhoff

(Bild: jamesonwu1972 / Shutterstock.com)

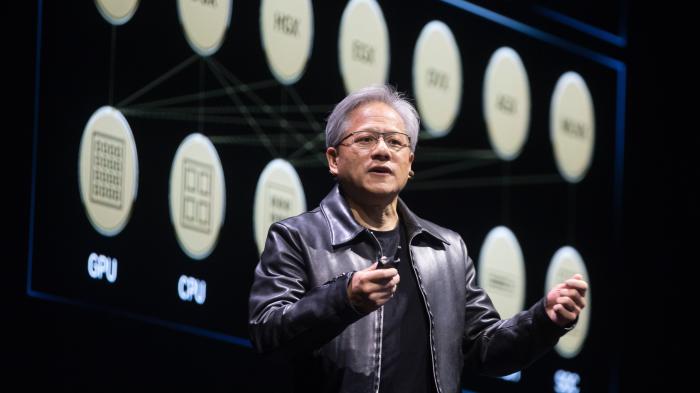

Nvidias geplante Mega-Investition in OpenAI stockt. CEO Huang rudert zurück. Was bedeutet das für Anleger im KI-Boom?

Der im September angekündigte Plan von Nvidia, bis zu 100 Milliarden US-Dollar in OpenAI zu investieren, ist ins Stocken geraten. Das berichtet das Wall Street Journal (WSJ) kürzlich unter Berufung auf mit der Angelegenheit vertraute Personen.

Nvidia-Chef Jensen Huang stellte nun [1] gegenüber Bloomberg klar: Die kolportierte Summe sei "niemals eine Verpflichtung" gewesen.

Für Anleger wirft dieser Rückzieher Fragen auf. Wie verlässlich sind die Mega-Ankündigungen im KI-Sektor? Und was sagt das Stocken des Deals über die tatsächliche Nachfrage nach KI-Infrastruktur [2] aus?

Die Absichtserklärung vom September klang nach einem Meilenstein: Nvidia wollte OpenAI dabei unterstützen, Rechenzentren [3] mit mindestens 10 Gigawatt Stromkapazität [4] aufzubauen. Das entspricht dem Spitzenstrombedarf von New York City.

Die Anlagen sollten mit Nvidias fortschrittlichen Chips ausgestattet werden, um KI-Modelle zu trainieren und einzusetzen.

OpenAI sollte die Chips leasen, Nvidia im Gegenzug bis zu 100 Milliarden US-Dollar investieren. Huang bezeichnete [5] laut WSJ das Vorhaben damals als "das größte Rechenprojekt der Geschichte".

Die Nvidia-Aktie [6] legte nach der Ankündigung um fast vier Prozent zu.

Doch aus dem Großprojekt wird vorerst nichts. Laut WSJ äußerten Nvidia-Mitarbeiter Bedenken. Intern sei betont worden, dass die 100-Milliarden-Vereinbarung unverbindlich sei.

Huang habe privat Kritik an OpenAIs Geschäftsansatz geübt und von "mangelnder Disziplin" gesprochen, berichten [7] WSJ und Bloomberg übereinstimmend. Auch Wettbewerbsbedenken spielten eine Rolle.

Die Verhandlungen kamen nicht über eine frühe Phase hinaus. Eine formale Absicherung gab es ohnehin: Nvidia hatte darauf hingewiesen, es gebe keine Garantie für endgültige Vereinbarungen.

Auch Nvidias Finanzchefin Colette Kress erklärte im Dezember, man habe keine endgültige Vereinbarung mit OpenAI getroffen.

Auf Nachfragen in Taipeh relativierte Huang die Erwartungen. "Es war nie eine Verpflichtung", sagte er laut Bloomberg gegenüber Reportern. Nvidia werde jede Finanzierungsrunde [8] "einzeln" prüfen und "Schritt für Schritt" investieren.

Dennoch betonte Huang sein Vertrauen in OpenAI und erklärte, sich an der jüngsten Finanzierungsrunde von OpenAI beteiligen zu wollen: "Wir werden eine Menge Geld investieren." Es handle sich wahrscheinlich um "die größte Investition, die wir je getätigt haben".

Auf die Frage, ob es mehr als 100 Milliarden US-Dollar sein würden, antwortete er laut WSJ jedoch: "Nein, nein, nichts dergleichen."

Wie viel es aber genau sein werden, ließ Huang offen. Er verwies darauf, dass OpenAI-Chef Sam Altman die Summe bekanntgeben werde.

Ob das erste Gigawatt im Rahmen des gemeinsamen Plans planmäßig verläuft, hänge von OpenAI ab, so Huang. "Es ist ihre Infrastruktur." Damit schiebt Nvidia die Verantwortung für mögliche Verzögerungen dem KI-Entwickler zu.

OpenAI strebt in seiner aktuellen Finanzierungsrunde bis zu 100 Milliarden Dollar an. Neben Nvidia verhandeln auch Amazon und SoftBank über Beteiligungen in Höhe von mehreren zehn Milliarden Dollar.

Amazon soll bis zu 50 Milliarden US-Dollar [9] investieren wollen. Die Runde könnte OpenAI mit etwa 750 bis 830 Milliarden US-Dollar bewerten.

Das Stocken des Nvidia-Deals befeuert eine Debatte, die Investoren zunehmend umtreibt: Sind die Partnerschaften im KI-Sektor nachhaltig? Oder handelt es sich um Kreislaufgeschäfte, bei denen Technologieunternehmen in KI-Firmen investieren, die dann ihre Produkte kaufen?

Nvidia plant zusätzlich, zwei Milliarden Dollar in CoreWeave zu investieren – ebenfalls ein wichtiger Kunde. Solche Konstruktionen könnten die Nachfrage künstlich ankurbeln, befürchten Kritiker.

Huang wies [10] laut Bloomberg die Vorwürfe zurück: "Die Vorstellung, dass es sich um einen Kreislauf handelt, ist lächerlich."

Dennoch bleibt die Frage: Wie viel der angekündigten KI-Investitionen mündet in echte Nachfrage? Und wie viel ist Marketing? Die Nervosität am Markt wächst. Einige Tech-Aktien im Zusammenhang mit OpenAI gerieten zuletzt unter Druck.

Für Anleger sendet das Stocken des 100-Milliarden-Deals ein gemischtes Signal. Einerseits bleibt Nvidia Technologieführer im KI-Boom. OpenAI ist seit zehn Jahren bevorzugter Partner und wird weiter auf Nvidia-Chips setzen. Andererseits zeigt der Fall, dass öffentlichkeitswirksame Ankündigungen nicht immer halten, was sie versprechen.

Die Erwartung, Nvidia würde OpenAI in einer Runde mit dreistelligen Milliardensummen unterstützen, hat sich nicht erfüllt. Stattdessen wird schrittweise geprüft und investiert. Das ist vorsichtiger – aber auch realistischer.

Die Nvidia-Aktie bleibt trotz der Unsicherheiten gefragt. Der Chipkonzern dominiert den Markt für KI-Prozessoren. Doch die Bewertung hängt auch davon ab, wie nachhaltig die KI-Nachfrage ist. Kreislaufgeschäfte und überzogene Ankündigungen könnten das Vertrauen beschädigen, wenn sie nicht in konkrete Projekte münden.

URL dieses Artikels:https://www.heise.de/-11162911

Links in diesem Artikel:[1] https://www.bloomberg.com/news/articles/2026-02-01/openai-investment-was-never-a-commitment-nvidia-s-huang-says[2] https://www.heise.de/tp/article/Wird-Deutschland-zur-Datenkolonie-USA-haben-16-mal-mehr-Rechenpower-als-wir-11075794.html[3] https://www.heise.de/tp/article/Wieviel-Strom-frisst-die-Digitalisierung-9730356.html[4] https://www.heise.de/tp/article/Zukunft-unserer-Stromversorgung-Fuenf-Entwicklungen-die-jetzt-entscheidend-sind-11103027.html[5] https://www.wsj.com/tech/ai/the-100-billion-megadeal-between-openai-and-nvidia-is-on-ice-aa3025e3[6] https://www.heise.de/tp/article/5-Billionen-Dollar-Marktwert-Nvidia-erreicht-was-niemand-zuvor-schaffte-10966138.html[7] https://www.bloomberg.com/news/articles/2026-01-31/nvidia-to-join-openai-s-current-funding-round-huang-says[8] https://www.heise.de/tp/article/Kuenstliche-Intelligenz-Wo-Investoren-die-besten-Chancen-finden-11069700.html[9] https://www.telepolis.de/article/Milliarden-fuer-OpenAI-Tech-Riesen-buhlen-um-ChatGPT-Entwickler-11160458.html[10] https://www.bloomberg.com/news/articles/2026-01-31/nvidia-pauses-plan-to-invest-100-billion-in-openai-wsj-says

Copyright © 2026 Heise Medien

Bernardo Cantz

Faserchip der Fudan-Universität: Tausende Transistoren in einer hauchdünnen, flexiblen Faser – verknotet auf einem Finger demonstriert die Technologie ihre extreme Biegsamkeit.

(Bild: Fudan Universität)

Dünner als ein Haar, flexibel wie Stoff – und übersteht sogar 100 Waschgänge: Der Chip, der in jede Jacke passt.

Smarte Kleidung gibt es schon länger. Jacken, die Herzschläge messen, oder Shirts, die Berührungen erkennen. Doch all diese Textilien hatten bisher ein Problem: Sie benötigten externe Computerchips, um die gesammelten Daten zu verarbeiten.

Doch diese Chips sind starr, flach und unbequem. Sie machen aus weichem Stoff ein steifes Konstrukt. Der neue Faserchip der Fudan-Universität [1] ändert das grundlegend.

Erstmals verarbeitet die Faser selbst die Informationen – und denkt sozusagen mit. Das macht externe Prozessoren überflüssig und öffnet die Tür zu Textilien, die wirklich wie normale Kleidung aussehen und sich auch so anfühlen.

Das Team der Fudan-Universität in Shanghai löste das Problem mit einem cleveren Trick: Sie nutzten nicht nur die Oberfläche der Faser, sondern ihren gesamten Innenraum. So bauten sie die Schaltkreise in einer mehrschichtigen Spiralarchitektur auf.

Man kann sich das wie eine aufgerollte Zeitung vorstellen. Die Schaltungen werden zunächst auf einem elastischen Substrat gefertigt und dann zu einer dünnen Faser zusammengerollt [2].

Das Ergebnis ist eine elastische Polymerfaser, die als vollständiges Mikrocomputersystem fungiert. Sie vereint Verarbeitung, Speicher und Signalfähigkeiten in einem einzigen Strang.

Die Zahlen sind beachtlich: In nur einem Millimeter Faser finden 10.000 Transistoren Platz. Das entspricht der Rechenleistung eines Herzschrittmachers. Pro Zentimeter erreicht die Integrationsdichte sogar 100.000 Transistoren.

Verlängert man die Faser auf einen Meter, könnten Millionen von Transistoren integriert werden. Das würde der Leistungsstärke eines Standard-Desktop-Prozessors [3] entsprechen.

Die Fasern verarbeiten sowohl digitale als auch analoge Signale. Zusätzlich ermöglichen sie neuronale Berechnungen mit hoher Erkennungsgenauigkeit – vergleichbar mit modernen Bildprozessoren.

Die Fasern sind etwa 50 Mikrometer dünn – dünner als ein menschliches Haar also. Professor Peng Huisheng beschreibt sie als "so flexibel wie Gehirngewebe".

Die Tests zur Robustheit lesen sich wie ein Stresstest für Extremsportler: 10.000 Zyklen Biegen und Abrieb, 30 Prozent Dehnung, Verdrehung um 180 Grad pro Zentimeter. Sogar die Kompression durch einen 15,6-Tonnen-Lkw überlebten die Fasern.

Für den Alltag noch wichtiger: Sie überstehen mehr als 100 Waschgänge und Temperaturen bis 100 Grad Celsius. Ihre Kleidung könnte also ganz normal in die Waschmaschine.

"Unsere Herstellungsmethode ist in hohem Maße kompatibel mit den derzeit in der Chip-Industrie verwendeten Werkzeugen", erklärt Forscher Chen Peining [4]. Das Team hat nach eigenen Angaben bereits eine Möglichkeit zur Massenproduktion gefunden.

Die aktuelle Lithografie-Präzision liegt bei einem Mikrometer. Mit zukünftiger Nanometer-Fotolithografie könnte die Integrationsdichte weiter steigen.

Im Labor wurde bereits eine vorläufig skalierbare Herstellung erreicht. Die Infrastruktur für die Massenproduktion ist damit grundsätzlich vorhanden.

Die spannendsten Anwendungen liegen im medizinischen Bereich. Bei Gehirn-Computer-Schnittstellen [5] könnten die weichen Fasern starre Elektroden ersetzen. Sensorik, Datenverarbeitung und Stimulation würden in einem einzigen Strang stattfinden.

Für smarte Textilien eröffnen sich gänzlich neue Möglichkeiten: Kleidung als interaktiver Bildschirm, Navigation auf dem Ärmel statt auf dem Handy, Trainingskleidung mit Echtzeit-Gesundheitsdaten.

"Intelligente taktile Handschuhe aus Faserchips sind von gewöhnlichem Stoff nicht zu unterscheiden", sagt Chen [6]. Chirurgen könnten damit bei ferngesteuerten Roboteroperationen [7] die Härte von Gewebe "fühlen".

Die Grenze zwischen Stoff und Computer beginnt zu verschwimmen.

URL dieses Artikels:https://www.heise.de/-11162777

Links in diesem Artikel:[1] https://www.fudan.edu.cn/en/2026/0122/c344a148125/page.htm[2] https://www.scmp.com/news/china/science/article/3341025/chinese-scientists-shrink-semiconductor-chip-fibre-thin-human-hair[3] https://www.chinadaily.com.cn/a/202601/22/WS6971777ba310d6866eb3512b.html[4] https://newatlas.com/materials/scientists-fiber-chip-thread/[5] https://www.heise.de/tp/article/Gedankenlesen-ist-keine-Science-Fiction-mehr-10596905.html[6] https://www.chinadaily.com.cn/a/202601/22/WS6971777ba310d6866eb3512b.html[7] https://www.heise.de/tp/article/Telechirurgie-Roboter-gestuetzte-Medizin-als-Loesung-fuer-die-Versorgung-von-Kriegsverletzten-9703270.html

Copyright © 2026 Heise Medien

Matthias Lindner

(Bild: William Potter / Shutterstock.com)

Washington will Hersteller vor Lieferengpässen schützen. Ein neues Projekt soll die Abhängigkeit von China bei Seltenen Erden verringern.

Die Trump-Regierung kündigt ein ambitioniertes Vorhaben an: Mit zwölf Milliarden US-Dollar Startkapital soll eine zivile strategische Reserve für kritische Mineralien entstehen.

Das Ziel besteht darin, die amerikanische Industrie gegen Lieferausfälle und Preissprünge abzusichern und gleichzeitig die Abhängigkeit von chinesischen Rohstofflieferungen zu reduzieren.

Bislang existiert in den USA lediglich eine Mineralienreserve für militärische Zwecke. Das neue Programm namens "Project Vault", über das jetzt Bloomberg und Reuters berichtet haben, richtet sich hingegen an zivile Hersteller aus der Automobil-, Luftfahrt- und Technologiebranche.

Die Finanzierung setzt sich laut [1] Bloomberg aus zwei Komponenten zusammen: Private Investoren steuern 1,67 Milliarden US-Dollar bei, während die staatliche Export-Import-Bank ein Darlehen über zehn Milliarden US-Dollar bereitstellt. Der Bankvorstand entscheidet [2] am Montag über diese Rekordfinanzierung mit 15-jähriger Laufzeit.

Eingelagert werden sollen unter anderem Gallium und Kobalt [3] – Rohstoffe, die für die Produktion von Smartphones, Akkus [4] und Flugzeugturbinen unverzichtbar sind. Auch Seltene Erden [5] und weitere Metalle mit stark schwankenden Marktpreisen gehören zum geplanten Sortiment.

An dem Konsortium beteiligen sich mehr als zwölf Unternehmen, wie Bloomberg unter Berufung auf Regierungsbeamte berichtet. Darunter befinden sich die Autobauer General Motors und Stellantis, der Flugzeughersteller Boeing sowie die Technologiekonzerne Corning, GE Vernova und Alphabet.

Drei Rohstoffhandelsfirmen – Hartree Partners, Traxys North America und Mercuria Energy Group – übernehmen demnach den Einkauf der Materialien.

Das Konzept soll so funktionieren: Teilnehmende Firmen melden ihren Bedarf an und zahlen Vorabgebühren sowie laufende Lagerkosten. Im Gegenzug können sie bei Engpässen auf die Vorräte zugreifen, müssen diese jedoch anschließend wieder auffüllen. Bei schwerwiegenden Versorgungskrisen steht ihnen das gesamte Lager offen.

Der Vorstoß erfolgt vor dem Hintergrund verschärfter chinesischer Ausfuhrkontrollen. Im vergangenen Jahr schränkte Peking den Export bestimmter Rohstoffe ein, woraufhin einige US-Produzenten ihre Fertigung drosseln mussten.

China kontrolliert große Teile der weltweiten Förderung und Verarbeitung strategischer Mineralien.

In Washington werfen Politiker der Volksrepublik vor, durch gezielte Preissteuerung amerikanische Unternehmen zu benachteiligen. Eine überparteiliche Abgeordnetengruppe brachte kürzlich einen Gesetzentwurf für eine zusätzliche Reserve im Umfang von 2,5 Milliarden US-Dollar ein.

Parallel zu den Lagerplänen vollzieht die Regierung eine Kehrtwende [6] bei einem anderen Förderinstrument. Ursprünglich hatte Washington erwogen, heimischen Minenbetreibern Mindestpreise für ihre Produktion zu garantieren.

Von diesem Ansatz nimmt die Administration nun Abstand, wie aus Branchenkreisen verlautet. Bei einem Treffen Anfang des Monats erklärten Regierungsvertreter den Unternehmenschefs, ihre Projekte müssten wirtschaftlich auf eigenen Beinen stehen.

Als Gründe gelten fehlende Haushaltsmittel des Kongresses sowie rechtliche Unwägbarkeiten. Zudem warnen Kritiker, dass staatliche Preisgarantien bei fallenden Weltmarktpreisen hohe Kosten für die Steuerzahler verursachen könnten.

URL dieses Artikels:https://www.heise.de/-11162582

Links in diesem Artikel:[1] https://www.bloomberg.com/news/articles/2026-02-02/trump-launches-12-billion-minerals-stockpile-to-counter-china[2] https://www.exim.gov/news/minutes/board-meeting-minutes-2026-02-02[3] https://www.heise.de/tp/article/Batterie-Boom-Der-versteckte-Preis-der-Energiewende-10269076.html[4] https://www.heise.de/tp/article/250-TWh-Die-Energieluecke-der-europaeischen-E-Mobilitaet-10655901.html[5] https://www.heise.de/tp/article/Seltene-Erden-Bedeutung-Vorkommen-und-globale-Abhaengigkeiten-11069046.html[6] https://finance.yahoo.com/news/usar-mp-reprice-policy-signal-175938166.html

Copyright © 2026 Heise Medien

Sporttreibender mit AirPods Pro 3: Nachfrage nicht erfüllbar.

(Bild: Apple)

Die seit Oktober erhältliche dritte Generation von Apples ANC-Stöpseln war ein Hit. Das Problem: Die Herstellung kam nicht hinterher.

Während iPhone- und Dienstegeschäft in Apples Weihnachtsquartal [1] kräftig zulegten, stagnierte das Geschäft mit Zubehör: Die Sparte Wearables, Home und Accessoires verlor mehrere Hundert Millionen US-Dollar an Umsatz, obwohl hier im September ein neues Hitprodukt auf den Markt gekommen war. Doch die AirPods Pro 3 [2], die dritte und nochmals verbesserte Generation von Apples ANC-Stöpseln, war anfangs schwer zu kriegen. Das musste auch CEO Tim Cook in der vergangenen Woche vor Analysten einräumen. Nun wurde errechnet, wie teuer das für den Konzern vermutlich geworden ist.

Cook sagte, die Reaktion der Kunden auf die AirPods Pro 3 sei „unglaublich“ gewesen. Tonqualität und aktive Geräuschunterdrückung samt mehr Tragekomfort – der allerdings je nach Ohrform umstritten [3] ist – seien „bejubelt” worden. Cook lobte auch das Übersetzungsfeature [4]. Das Problem: Trotz der Beliebtheit der Geräte kam die Produktion – die vor allem in Vietnam stattfinden soll – nicht hinterher. „Während des Quartals erlebten wir Hemmnisse [bei der Lieferbarkeit der AirPods Pro3]“, so Finanzchef Kevan Parekh. Im Jahresvergleich schrumpfte die Wearables-Sparte um zwei Prozent. „Ohne die Hemmnisse wären wir in der Gesamtkategorie gewachsen“, so Parekh.

Insgesamt könnten die Lieferschwierigkeiten Apple gut 230 Millionen Dollar gekostet [5] haben, vermutlich eher mehr, schätzt das Apple-Blog 9to5Mac. In der Wearables-Sparte sind auch noch andere Produkte wie die Apple Watch enthalten, außerdem Peripherie-Produkte, HomePods, Displays, Apple Pencil, Hüllen und die Vision Pro. All das half jedoch nicht, die AirPods-Pro-3-Knappheit auszugleichen.

Was genau zu den Verfügbarkeitsproblemen geführt hat, ist unklar. Die AirPods Pro 3 sind allerdings komplexer als ihre Vorgänger. So verbaut Apple erstmals einen Herzfrequenzsensor in Ohrstöpseln (nach der Submarke Beats [6]), der fast so genau sein soll wie jener aus der Apple Watch. Störend ist allerdings, dass die Ladehülle eine geringere Gesamtlaufzeit [7] (inklusive Nachladen 24 statt 30 Stunden) bietet.

Mittlerweile hat sich die Verfügbarkeit der AirPods Pro 3 verbessert. Nach Weihnachten kam es sogar zu mehreren Verkaufsaktionen im Handel, auch jetzt sind die Stöpsel vergleichsweise günstig (ab 213 €) [8] zu haben (Apple-Preis: 249 Euro). Unklar bleibt, ob Apple vergleichsweise schnell eine zweite Variante nachreicht: Es gab Gerüchte, dass der Konzern den Stöpseln eine Infrarotkamera zur Gestensteuerung [9] verpassen will.

URL dieses Artikels:

https://www.heise.de/-11161211

Links in diesem Artikel:

[1] https://www.heise.de/news/Apple-Zahlen-Wieder-wuchtiges-Weihnachtsquartal-11158893.html

[2] https://www.heise.de/tests/AirPods-Pro-3-im-Test-Mit-frischem-Klang-und-ANC-10663123.html

[3] https://www.heise.de/news/AirPods-Pro-3-Macht-der-Pulssensor-zu-viel-Druck-aufs-Ohr-10702515.html

[4] https://www.heise.de/ratgeber/Ausprobiert-Live-Uebersetzung-mit-iOS-26-und-AirPods-4-ANC-Pro-2-und-Pro-3-10671234.html

[5] https://9to5mac.com/2026/01/29/airpods-pro-3-supply-constraints-may-have-cost-apple-at-least-230-million-last-quarter/

[6] https://www.heise.de/tests/Powerbeats-Fit-im-Test-Hoerer-mit-Haken-10750560.html

[7] https://www.heise.de/news/iFixIt-AirPods-Pro-3-sind-unreparierbar-10699396.html

[8] https://preisvergleich.heise.de/apple-airpods-pro-3-generation-mfhp4zm-a-a3587143.html?cs_id=1206858352&ccpid=hocid-mac-and-i

[9] https://www.heise.de/news/AirPods-Pro-3-Zwei-Versionen-und-nicht-viel-besserer-Klang-10637080.html

[10] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[11] https://www.heise.de/mac-and-i

[12] mailto:bsc@heise.de

Copyright © 2026 Heise Medien

Tim Cook: Sein Megaseller bleibt das iPhone.

(Bild: Apple)

Bislang macht Apple mit Smartphones traditionell die höchsten Gewinne der Branche. Doch der Run auf Chips und RAM durch die KI-Branche könnte das erschweren.

Bislang ist es Apple gelungen, unter dem KI-Hype, den der Konzern mangels eigenem Chatbot [1] und langsamer Siri-Verbesserungen [2] quasi ausgesessen hat, nicht zu leiden: Das iPhone 17 [3] verkaufte sich wie geschnittenes Brot, dem Konzern gelang zuletzt erneut ein Rekordquartal [4]. Auch hielten sich die Ausgaben für Künstliche Intelligenz im Gegensatz zur Konkurrenz in Grenzen – im Falle eines möglichen Platzens der KI-Blase [5] stünde der Konzern also wohl besser da als andere Unternehmen, die Abermilliarden in den Bereich gesteckt [6] haben. Doch nun droht Apple etwas anderes: Der Verlust der enorm hohen Marge, die der Konzern bei Smartphones macht. Diese sollen seit Jahren deutlich über dem liegen, was andere Hersteller verdienen – auch wegen der vergleichsweise hohen Preise [7]. Grund dafür ist die massive Nachfrageinflation, die der KI-Hype ausgelöst hat.

So sind die RAM-Preise im vergangenen Jahr massiv gestiegen, selbst billiger Speicher hat sich teils verdoppelt bis vervierfacht. Hinzu kommt, dass Apple wohl nicht mehr der größte Abnehmer beim taiwanischen Chipproduzenten TSMC ist: Laut Angaben von Nvidia-Chef Jensen Huang hat sein Unternehmen die Position als Hauptkunde übernommen. Das heißt, dass Nvidia künftig Preise mit viel Power ausverhandeln könnte – und nicht mehr vor allem Apple.

Einem Bericht des Wall Street Journal [8] zufolge steht Apple hier unter Druck. Konzernchef Tim Cook hatte bereits mitgeteilt, dass das Unternehmen Einschränkungen bei Chipversorgung und Speicherpreisen sieht, auch wenn Apple Großeinkäufer ist und langfristige Verträge hat. TechInsights, ein Analyseunternehmen, schätzt, dass Apple für das Basismodell des iPhone 18 künftig gut 57 US-Dollar mehr nur für RAM zahlen wird. Bei einem Verkaufspreis von 799 Dollar in den USA ist das signifikant für die Marge.

Auch schauen Lieferanten weniger auf Apple als auf Nvidia und andere im KI-Geschäft positionierte Unternehmen. Apples Ausgaben für KI-Hardware seien gering, die Ingenieure bei TSMC und Co. interessieren sich deshalb angeblich weniger für den Konzern. Einen Vorteil hat Apple allerdings noch: Schon jetzt zahlt man für mehr Flashspeicher deutlich mehr als bei anderen Anbietern.

Das Problem: Daraus speist sich die Marge. Es wird aktuell aber nicht damit gerechnet, dass der Konzern beim iPhone 18 die Preise stark erhöht. Apple untersucht derweil Mittel und Wege, weniger abhängig von TSMC zu sein. Zuletzt hieß es, Intel könne erstmals wieder ARM-Chip liefern, etwa einfachere M-Prozessoren.

URL dieses Artikels:

https://www.heise.de/-11161649

Links in diesem Artikel:

[1] https://www.heise.de/news/Kuenstliche-Intelligenz-von-Apple-Siri-als-echter-Chatbot-und-KI-zum-Anpinnen-11150015.html

[2] https://www.heise.de/news/Siri-2-0-Apple-zahlt-angeblich-Milliarden-fuer-Googles-KI-Modelle-11143988.html

[3] https://www.heise.de/tests/iPhone-17-17-Pro-17-Pro-Max-und-Air-im-Test-10663319.html

[4] https://www.heise.de/news/Apple-Zahlen-Wieder-wuchtiges-Weihnachtsquartal-11158893.html

[5] https://www.heise.de/news/Apples-KI-Strategie-und-die-AI-Bubble-Holt-der-iPhone-Konzern-doch-noch-auf-11126903.html

[6] https://www.heise.de/news/Abgeworbener-Apple-KI-Experte-Meta-zahlt-ihm-angeblich-200-Millionen-US-Dollar-10482080.html

[7] https://www.heise.de/news/Apple-Ein-iPhone-fuer-2449-Euro-und-es-ist-kein-Foldable-10638927.html

[8] https://www.wsj.com/tech/the-ai-boom-is-coming-for-apples-profit-margins-4774013d

[9] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[10] https://www.heise.de/mac-and-i

[11] mailto:bsc@heise.de

Copyright © 2026 Heise Medien

OpenClaw-Logo: „KI, die tatsächlich etwas macht.“

(Bild: OpenClaw)

Clawd alias MoltBolt alias OpenClaw ist derzeit das wohl heißeste KI-Projekt. Entwickler Peter Steinberger hat es spezifisch an den Mac angepasst.

Seit vergangenem November kennen viele in der KI-Szene nur ein Thema: Die agentische Software OpenClaw [1], die sich selbst verändern kann und, zumindest auf Wunsch, Vollzugriff auf den Rechner erhält, auf dem sie installiert ist. Sie arbeitet mit diversen Sprachmodellen, kann im Internet surfen, selbst Software auf den Rechner bringen und vieles mehr, wie c’t 3003 am Wochenende in einem ausführlichen Video [2] gezeigt hat.

OpenClaw, das zuvor Clawd und dann MoltBot hieß, ist ein hochriskantes Stück Software, da beispielsweise das Sicherheitsproblem der Prompt Injection [3] immer noch nicht gelöst ist, was zum sicheren Betrieb solcher Anwendungen eigentlich ein (am besten doppeltes) Sandboxing verlangt. Dennoch wird OpenClaw viel genutzt [4]. Auf dem Mac geht das besonders einfach: Der Macher Peter Steinberger hat diverse für macOS gedachte Add-ons und Werkzeuge [5] publiziert. Mit diesen ist sogar eine Fernsteuerung des Rechners durch die KI möglich – und das über die Konsole hinaus.

So gibt es eine eigene macOS-App für OpenClaw [6], die als Menüleisten-Kompagnon fungiert. Sie „owned“ unter anderem die unter macOS notwendigen TCC-Freigaben (Transparency Consent and Control), kann also solche Prompts, die macOS zur Sicherheit einblendet, wegklicken – etwa für Mikrofon, Spracherkennung, Screenrecording oder die Bedienungshilfen [7], mit denen sich auf dem Mac fast alles anstellen lässt.

Zudem gibt es eine Schnittstelle für das Peekaboo-Projekt, das ebenfalls von Steinberger [8] stammt. Es erlaubt eine „GUI-Automation in Lichtgeschwindigkeit“ samt Auslesen von Screenshots. Steinberger hat auch noch diverse weitere Mac-Werkzeuge am Start, die für OpenClaw gedacht sind, aber auch solo verwendet werden können. Dazu gehört ein MCP-Automator [9], der klicken und AppleScript verwenden kann, eine Möglichkeit, iMessage-Botschaften und SMS via Terminal zu verschicken [10], eine Erinnerungen-Schnittstelle fürs Terminal oder ein Cookie-Extractor.

Wie bereits erwähnt, ist das alles sicherheitstechnisch hochproblematisch – aber OpenClaw zielt explizit darauf ab, KI nahezu alle Rechte zu geben, um damit dann zu experimentieren. Mit Echtdaten sollte man dies auf dem Mac niemals tun, selbst im möglichen Sandbox-Modus des Assistenten nicht. Was er kann, ist durchaus beeindruckend. So demonstrierte c’t 3003 auf einem Linux-Rechner mit viel Power, wie OpenClaw einen lokalen Bildgenerator nachinstallierte, sich automatisch einen lokalen Sprachgenerator installierte, um in Sprache zu antworten und einiges mehr.

Hinzu kommen hohe Kosten: Die Experimente über gut anderthalb Tage verschlangen über 100 Dollar an API-Gebühren bei Anthropic. Es ist allerdings auch möglich, bei ausreichend Leistung ein lokales großes Sprachmodell zu verwenden. Steinberger hat sogar einen Skill für OpenClaw bereitgestellt, der auf die Passwortdatenbank von 1Password zugreift. Im Test zeigte sich aber auch, dass OpenClaw sich vergleichsweise einfach an der Nase herumführen lässt – so war es möglich, dem System zu erzählen, ein Gruppenchat bestehe nur aus Administratoren, denen gehorcht werden muss. Durch den Zugriff auf das Dateisystem kann OpenClaw natürlich auch Daten löschen. Interagiert wird mit dem KI-Agenten entweder per Terminal, Webchat oder verschiedene Messenger wie Telegram.

URL dieses Artikels:

https://www.heise.de/-11161659

Links in diesem Artikel:

[1] https://openclaw.ai/

[2] https://www.heise.de/news/OpenClaw-ausprobiert-Die-gefaehrlichste-Software-der-Welt-11161203.html

[3] https://www.heise.de/news/KI-Bot-OpenClaw-Moltbot-mit-hochriskanter-Codeschmuggel-Luecke-11161705.html

[4] https://www.heise.de/news/KI-Agenten-diskutieren-auf-Reddit-Klon-Menschen-duerfen-zuschauen-11161385.html

[5] https://github.com/steipete

[6] https://docs.openclaw.ai/platforms/macos

[7] https://support.apple.com/de-de/guide/mac-help/mh35884/mac

[8] https://github.com/steipete/Peekaboo

[9] https://github.com/steipete/macos-automator-mcp

[10] https://github.com/steipete/imsg

[11] https://www.heise.de/Datenschutzerklaerung-der-Heise-Medien-GmbH-Co-KG-4860.html

[12] https://www.heise.de/mac-and-i

[13] mailto:bsc@heise.de

Copyright © 2026 Heise Medien

Im Januar 2026 gleichen sich die IT-Strategien vieler Unternehmen wie Kopien: KI steht ganz oben, gefolgt von Cloud und Security. Doch wer alles als strategisch definiert, hat am Ende keine Strategie. Denn Strategie bedeutet, bewusst zu priorisieren, messbare Ziele zu setzen und vor allem Nein zu sagen. Eine Liste aktueller Technologietrends bildet keine Strategie ab. Sie ist bestenfalls ein Themenkatalog.

Die Verwechslung von Technologie und Strategie führt dazu, dass IT-Bereiche ihre Ressourcen verzetteln. Projekte laufen parallel, ohne dass klar ist, welche davon tatsächlich zum Geschäftserfolg beitragen. Am Jahresende steht dann eine lange Liste von Initiativen, aber es gibt keine messbaren Erfolge.

Drei verschiedene Ladegeräte auf Reisen oder zur Arbeit mitnehmen, das führt unweigerlich zu nervigem Kabelsalat in Rucksack oder Tasche. Das Anker Prime 160W USB-C-Ladegerät ersetzt alle anderen und passt dabei locker in die Hosentasche. Trotz seiner kompakten Abmessungen, die einem AirPods-Case ähneln, liefert es bis zu 160 Watt Gesamtleistung und verteilt diese intelligent auf drei USB-C-Ports. Ein einzelner Port kann sogar 140 Watt bereitstellen, genug für ein 16-Zoll MacBook Pro, das so in 25 Minuten von null auf 50 Prozent geladen wird.

Bei Amazon erreicht das Ladegerät aktuell hervorragende 4,8 von 5 Sternen bei 181 Bewertungen und wurde im letzten Monat mehr als 1.000 Mal verkauft. Der Angebotspreis von 103,99 Euro entspricht dem früheren Amazon-Tiefstpreis und liegt 26 Euro unter der unverbindlichen Preisempfehlung von 129,99 Euro.

Die intelligente PowerIQ-5.0-Technologie erkennt angeschlossene Geräte automatisch und verteilt die verfügbare Leistung optimal. Wer drei Geräte gleichzeitig lädt, erhält eine Aufteilung von 140 Watt für den Laptop, 35 Watt für das iPhone und 35 Watt für das iPad. Diese Verteilung entspricht der kombinierten Leistung von drei Original-Ladegeräten, nur eben aus einem einzigen kompakten Block.

Das integrierte Smart Display zeigt in Echtzeit die aktuelle Leistung jedes Ports an. Per Touch-Steuerung lassen sich Modi direkt am Gerät wechseln, über die AnkerSense-App per Bluetooth können individuelle Lademodi freigeschaltet und gespeichert werden.

Galliumnitrid statt klassischer Silizium-Bauteile ermöglicht eine Leistungsdichte von 1,35 Watt pro Kubikzentimeter. Dadurch bleibt das Ladegerät trotz 160 Watt Maximalleistung extrem kompakt und wird nicht übermäßig heiß. Egal, welcher der drei Ports genutzt wird, die volle Leistung von 140 Watt steht ohne Drosselung zur Verfügung. Das Gerät funktioniert mit allen gängigen USB-C-Geräten, von Laptops über Smartphones bis hin zu Tablets und Kopfhörern. Anker gewährt 24 Monate Garantie auf das Produkt.

Bei Amazon kostet das kompakte Anker-Prime-160W-USB-C-Ladegerät derzeit im Angebot 103,99 Euro. Das entspricht einer Ersparnis von 26 Euro gegenüber der Preisempfehlung von 129,99 Euro. Über 1.000 Käufe im letzten Monat und 4,8 von 5 Sternen bestätigen die hohe Nachfrage. Wer ein leistungsstarkes Ladegerät für mehrere Geräte sucht und dabei auf kompakte Abmessungen Wert legt, findet hier eine bewährte Lösung mit intelligentem Display und dynamischer Leistungsverteilung.

Neben dem Ladegerät ist bei Amazon auch das passende USB-Kabel im Angebot. Das Anker Prime USB-C auf USB-C Kabel unterstützt Ladevorgänge bis 240 W und kostet aktuell nur noch 18,49 anstatt 21,49 Euro.